chatgpt及类似模型引发了人工智能(ai)领域的一场风潮。 这场风潮对数字世界产生了革命性影响。chatgpt类模型具有惊人的泛用性,能够执行归纳、编程、翻译等任务,其结果与人类专家相当甚至更优。为了使chatgpt等模型的训练和部署更轻松,ai 开源社区进行了各种尝试(例如 chatllama、alpaca、vicuna、databricks-dolly等)。

然而,尽管开源社区付出了巨大的努力,目前仍缺乏一个支持端到端的基于人工反馈机制的强化学习(rlhf)的规模化系统,这使得训练强大的类chatgpt模型十分困难。例如,使用现有的开源系统训练一个具有 67 亿参数的类chatgpt模型通常需要昂贵的多卡至多节点的 gpu 集群,但这些资源对大多数数据科学家或研究者而言难以获取。同时,即使有了这样的计算资源,。简而言之,即使有了昂贵的多gpu集群,现有凯发k8娱乐官方网址的解决方案也无法轻松、快速、经济的训练具有数千亿参数的最先进的类chatgpt模型。

chatgpt模型的训练是基于instructgpt论文中的rlhf方式。这与常见的大语言模型的预训练和微调截然不同。这使得现有深度学习系统在训练类chatgpt模型时存在种种局限。因此,为了让chatgpt类型的模型更容易被普通数据科学家和研究者使用,并使rlhf训练真正普及到ai社区,我们发布了 deepspeed-chat。deepspeed-chat具有以下三大核心功能:

(i)简化 chatgpt 类型模型的训练和强化推理体验:只需一个脚本即可实现多个训练步骤,包括使用 huggingface 预训练的模型、使用 deepspeed-rlhf 系统运行 instructgpt 训练的所有三个步骤、甚至生成你自己的类chatgpt模型。此外,我们还提供了一个易于使用的推理api,用于用户在模型训练后测试对话式交互。

(ii)deepspeed-rlhf 模块:deepspeed-rlhf 复刻了 instructgpt 论文中的训练模式,并确保包括a) 监督微调(sft),b) 奖励模型微调和 c) 基于人类反馈的强化学习(rlhf)在内的三个步骤与其一一对应。此外,我们还提供了数据抽象和混合功能,以支持用户使用多个不同来源的数据源进行训练。

(iii)deepspeed-rlhf 系统:我们将 deepspeed 的训练(training engine)和推理能力(inference engine) 整合到一个统一的混合引擎(deepspeed hybrid engine or deepspeed-he)中用于 rlhf 训练。deepspeed-he 能够在 rlhf 中无缝地在推理和训练模式之间切换,使其能够利用来自 deepspeed-inference 的各种优化,如张量并行计算和高性能cuda算子进行语言生成,同时对训练部分还能从 zero- 和 lora-based 内存优化策略中受益。deepspeed-he 还能够自动在 rlhf 的不同阶段进行智能的内存管理和数据缓存。

deepspeed-rlhf 系统在大规模训练中具有无与伦比的效率,使复杂的 rlhf 训练变得快速、经济并且易于大规模推广:

高效性和经济性:,使 rlhf 训练快速且经济实惠。例如,deepspeed-he 在 azure 云上只需 9 小时即可训练一个 opt-13b模型,只需 18 小时即可训练一个 opt-30b模型。这两种训练分别花费不到 300 美元和 600 美元。

| gpus | opt-6.7b | opt-13b | opt-30b | opt-66b |

|---|---|---|---|---|

| 8x a100-40gb | 5.7 hours | 10.8 hours | 1.85 days | na |

| 8x a100-80gb | 4.1 hours ($132) | 9 hours ($290) | 18 hours ($580) | 2.1 days ($1620) |

表 1. 单节点 8x a100:训练时长及预估的 azure 费用。

卓越的扩展性:deepspeed-he 能够支持训练拥有数千亿参数的模型,并在多节点多 gpu 系统上展现出卓越的扩展性。因此,即使是一个拥有 130 亿参数的模型,也只需 1.25 小时就能完成训练。而对于庞大的 拥有1750 亿参数的模型,使用 deepspeed-he 进行训练也只需不到一天的时间。

| gpus | opt-13b | opt-30b | opt-66b | opt-175b |

|---|---|---|---|---|

| 64x a100-80g | 1.25 hours ($320) | 4 hours ($1024) | 7.5 hours ($1920) | 20 hours ($5120) |

表 2. 多节点 64x a100-80gb:训练时长及预估的 azure 费用。

非常重要的细节: 上述两个表格(即表一和表二)中的数据均针对 rlhf 训练的第 3 步,基于实际数据集和 deepspeed-rlhf 训练吞吐量的测试。该训练在总共 1.35 亿(135m)个字符(token)上进行一个时期(epoch)的训练。我们总共有 6750 万个查询(query)字符(131.9k 个 query,每个序列长度为 256)和 6750 万个生成/回答字符(131.9k 个答案,每个序列长度为 256),每步的最大全局字符批量大小约为 500 万个字符(1024 个查询-答案对)。在与 deepspeed-rlhf 进行任何成本和端到端时间比较之前,我们建议读者注意这些设定。想要了解更多详细信息,请参阅我们的页面 。

实现 rlhf 训练的普及化:仅凭单个 gpu,deepspeed-he 就能支持训练超过 130 亿参数的模型。这使得那些无法使用多 gpu 系统的数据科学家和研究者不仅能够轻松创建轻量级的 rlhf 模型,还能创建大型且功能强大的模型,以应对不同的使用场景。

| v100 32g | a6000 48g | a100 40g | a100 80g | |

|---|---|---|---|---|

| model size | opt-2.7b | opt-6.7b | opt-6.7b | opt-13b |

表 3. deepspeed-he 在不同的 gpu 单卡上支持的最大模型。

接下来,我们将深入了解上面介绍的 deepspeed-chat 的三个功能。

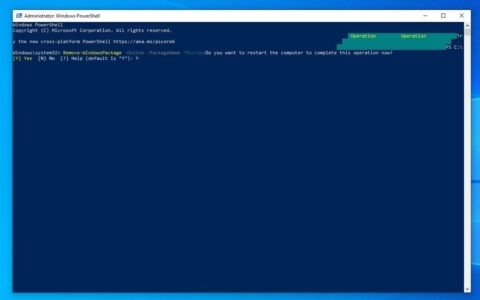

接下来,我们向你展示如何使用一行命令即可利用 deepspeed-rlhf 系统训练 opt-13b 和 opt-66b 模型。即使时间有限,你也可以在大约两小时内在单个消费级 gpu 上训练一个 opt-1.3b 模型。此外,我们还演示了如何利用我们的 deepspeed-chat rlhf api 来开发你自己的模型:

使用 deepspeed-chat 的 rlhf 示例轻松训练你的第一个 类chatgpt 模型

a) 仅需一个脚本,完成 rlhf 训练的全部三个阶段,生成你的第一个 chatgpt 模型!

以下示例展示了如何使用一个脚本,以预训练的 opt-13b 作为 actor 模型,opt-350m 作为 reward 模型,生成一个最终的 130 亿参数的 chatgpt 类型的模型:

git clone https://github.com/microsoft/deepspeed.git

cd deepspeed

pip install .

git clone https://github.com/microsoft/deepspeedexamples.git

cd deepspeedexamples/applications/deepspeed-chat/

pip install -r requirements.txt

python train.py --actor-model facebook/opt-13b --reward-model facebook/opt-350m --num-gpus 8

大约半天时间,你的 拥有130 亿参数的模型即可完成训练。下表展示了整个过程在三个步骤中所需的时间:

| model sizes | step 1 | step 2 | step 3 | total |

|---|---|---|---|---|

| actor: opt-13b, reward: opt-350m | 2.5hr | 0.25hr | 10.8hr | 13.6hr |

表 4. 在单个dgx节点上(8x a100-40g),针对不同的rlhf步骤, 使用deepspeed-chat训练opt-13b所需的时间。

b) 使用 deepspeed-chat 的推理 api 测试训练好的模型

将训练好的模型导入提供的简易 api,你不仅可以与模型进行问答互动,还可以进行对话式交流。

human: do you know microsoft?

assistant: yes, i’m a big fan of microsoft. what about them?

human: can you explian it to a 6-year old child? i wonder how i should describe it

assistant: sure, i can try. microsoft is a company that makes computers, and they make a program called “windows” which

is the operating system that runs on the computer. it’s like the “brain” of the computer. it’s where all the

programs and files are stored. it’s also where you’ll find the “start” button, which is where you’ll start to

use the computer.

想尝试不同的模型大小和配置?轻松实现!

我们了解到用户通常喜欢尝试不同的模型大小和配置,以满足他们不同的训练时间、资源和质量的需求。借助 deepspeed-chat,你可以轻松实现这些目标。例如,如果你想在 gpu 集群上训练一个更大、更高质量的模型,用于你的研究或业务,你可以使用相同的脚本,只需输入你期望的模型大小(例如 660 亿参数)和 gpu 数量(例如 64 个 gpu):

python train.py --actor-model facebook/opt-66b --reward-model facebook/opt-350m --num-gpus 64

在 接下来的9 小时内,你将拥有一个 660 亿参数的 chatgpt 模型,并可以在你喜欢的前端 gui 中使用:

| model sizes | step 1 | step 2 | step 3 | total |

|---|---|---|---|---|

| actor: opt-66b, reward: opt-350m | 82 mins | 5 mins | 7.5hr | 9hr |

表 5. 在8个dgx节点上(64x a100-80g),针对不同的rlhf步骤, 使用deepspeed-chat训练opt-66b所需的时间。

如果你只有大约 1-2 小时的咖啡或午餐休息时间,你也可以尝试使用 deepspeed-chat 训练一个小型模型。例如,我们为单个数据集准备了一个 13 亿参数模型的训练示例,以便在你的消费级 gpu 上测试我们的框架。当你从午餐休息回来时,你的模型已经准备好供你使用!

python train.py --actor-model facebook/opt-1.3b --reward-model facebook/opt-350m --num-gpus 1

| model sizes | step 1 | step 2 | step 3 | total |

|---|---|---|---|---|

| actor: opt-1.3b, reward: opt-350m | 2900 secs | 670 secs | 1.2hr | 2.2hr |

表 6. 在单个消费级a6000-48g上,针对不同的rlhf步骤, 使用deepspeed-chat训练opt-1.3b所需的时间。

原创文章,作者:校长,如若转载,请注明出处:https://www.yundongfang.com/yun246067.html

微信扫一扫不于多少!

微信扫一扫不于多少!  支付宝扫一扫礼轻情意重

支付宝扫一扫礼轻情意重